Le reti neurali hanno avuto un enorme impatto sul modo in cui gli ingegneri progettano dispositivi di controllo per i robot, stimolando lo sviluppo di macchine più adattabili ed efficienti. Tuttavia, i sistemi di apprendimento automatico simili al cervello sono un’arma a doppio taglio: la loro complessità li rende potenti, ma rende anche difficile garantire che un robot alimentato da una rete neurale completi il suo compito in modo sicuro.

Il modo tradizionale per verificare l’integrità e la stabilità è attraverso tecniche chiamate funzioni di Lyapunov. Se riesci a trovare una funzione di Lyapunov il cui valore diminuisce costantemente, puoi sapere che non si verificheranno mai situazioni pericolose o instabili associate a valori più alti. Tuttavia, per i robot controllati da reti neurali, i metodi precedenti per verificare le condizioni di Lyapunov non erano adatti per macchine complesse.

I ricercatori del Laboratorio di informatica e intelligenza artificiale del MIT e altrove hanno sviluppato nuove tecniche che convalidano rigorosamente i calcoli di Lyapunov in sistemi più complessi. Il loro algoritmo ricerca e verifica in modo efficiente la funzione Lyapunov, fornendo una garanzia di stabilità del sistema. Questo approccio potrebbe potenzialmente consentire un dispiegamento più sicuro di robot e veicoli autonomi, compresi aerei e veicoli spaziali.

Per migliorare le prestazioni degli algoritmi precedenti, i ricercatori hanno trovato una scorciatoia economica al processo di formazione e convalida. Hanno creato controesempi più economici, ad esempio dati ostili provenienti da sensori che avrebbero respinto il controller, e poi hanno migliorato il sistema automatizzato per tenere conto di tali esempi. La comprensione di questi casi limite ha aiutato le macchine a imparare come affrontare condizioni difficili, consentendo loro di operare in sicurezza in una gamma di condizioni più ampia di quanto fosse possibile in precedenza. Hanno quindi sviluppato una nuova formulazione di verifica che consente l’uso di un verificatore di rete neurale scalabile, α,β-CROWN, per fornire garanzie rigorose per gli scenari peggiori oltre ai controesempi.

“Abbiamo visto “alcune prestazioni sperimentali impressionanti in macchine controllate dall’intelligenza artificiale come esseri umani e cani robot, ma questi controller AI non dispongono delle garanzie formali che sono fondamentali per i sistemi critici per la sicurezza”. «Il nostro lavoro colma il divario tra questo livello di prestazioni dei controller di rete neurale e le garanzie di sicurezza necessarie per implementare controller di rete neurale più complessi nel mondo reale», osserva Yang.

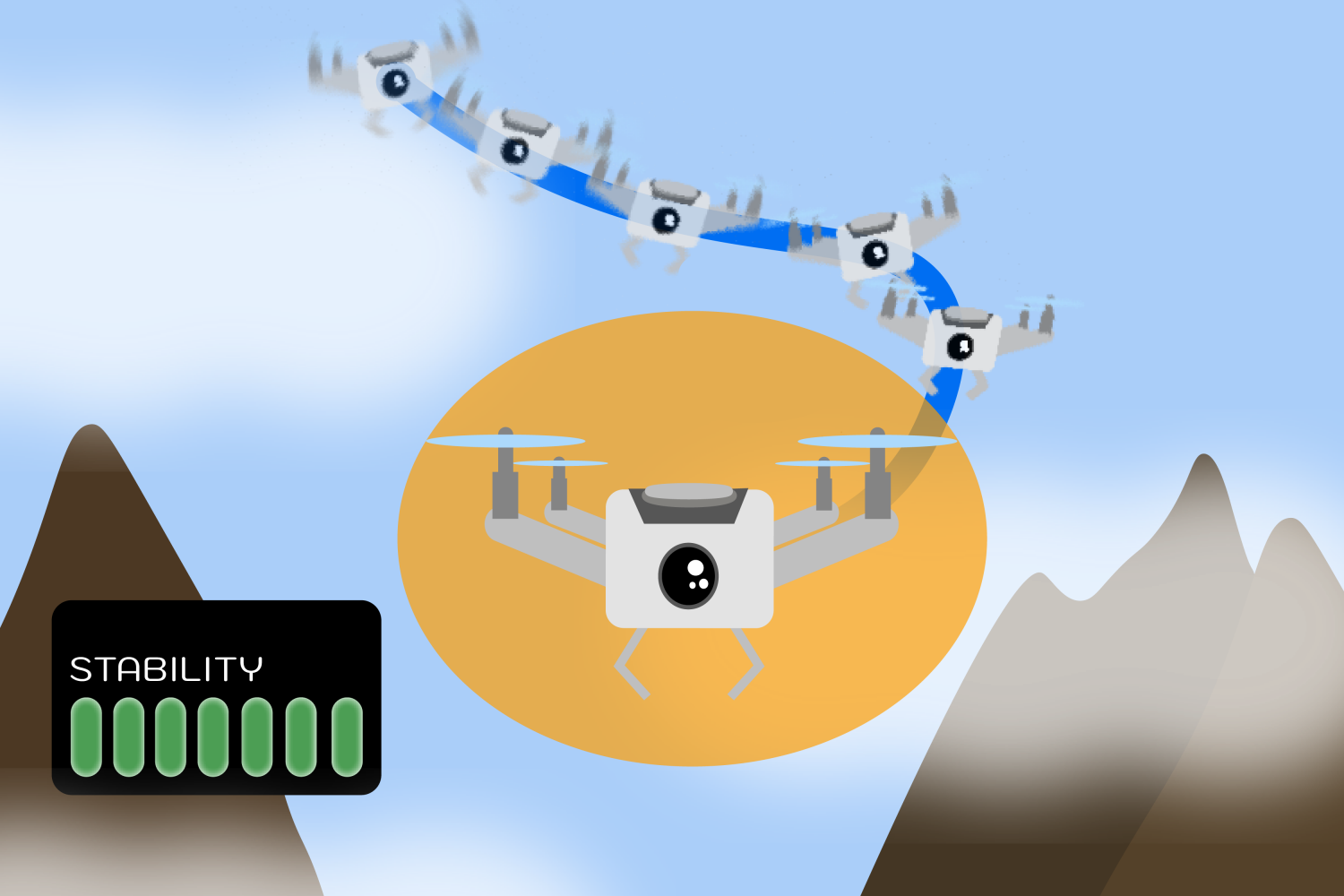

In una dimostrazione digitale, il team ha simulato come un drone quadricottero dotato di sensori Lidar si stabilizzerebbe in un ambiente 2D. Il loro algoritmo ha guidato con successo il drone in una posizione di volo stabile, utilizzando solo le limitate informazioni ambientali fornite dai sensori Lidar. In altri due esperimenti, il loro approccio ha consentito il funzionamento stabile di due sistemi robotici simulati in una gamma più ampia di condizioni: un pendolo invertito e un veicolo che segue il percorso. Questi esperimenti, sebbene modesti, sono relativamente più complessi di quanto la comunità di verifica delle reti neurali sia stata in grado di fare prima, soprattutto perché coinvolgono modelli di sensori.

“A differenza dei comuni problemi di machine learning, l’uso preciso delle reti neurali come funzioni di Lyapunov richiede la risoluzione di difficili problemi di ottimizzazione globale, quindi la scalabilità “È il principale collo di bottiglia.” “Il presente lavoro fornisce un contributo importante sviluppando approcci algoritmici meglio progettati per l’uso specifico delle reti neurali come funzioni di Lyapunov nei problemi di controllo. Ottiene un notevole miglioramento nella scalabilità e nella qualità delle soluzioni rispetto agli approcci esistenti ulteriore sviluppo di algoritmi di ottimizzazione per metodi neurali di Lyapunov e utilizzo di “Precisione dell’apprendimento profondo nel controllo e nella robotica in generale”.

L’approccio alla stabilità introdotto da Yang e dai suoi colleghi ha ampie applicazioni potenziali in cui garantire la sicurezza è fondamentale. Potrebbe contribuire a garantire una guida più fluida per i veicoli autonomi, come aeroplani e veicoli spaziali. Allo stesso modo, i droni che consegnano oggetti o mappano terreni diversi potrebbero beneficiare di tali garanzie di sicurezza.

Le tecniche qui sviluppate sono molto generali e non si limitano alla sola robotica; Le stesse tecnologie potrebbero aiutare in altre applicazioni, come la biomedicina e la lavorazione industriale, in futuro.

Sebbene questa tecnica rappresenti un aggiornamento rispetto al lavoro precedente in termini di scalabilità, i ricercatori stanno esplorando come potrebbe funzionare meglio nei sistemi a dimensioni superiori. Vogliono anche considerare i dati oltre le letture lidar, come immagini e nuvole di punti.

Come direzione futura della ricerca, il team vorrebbe fornire le stesse garanzie di stabilità per i sistemi situati in ambienti incerti e soggetti a disturbi. Ad esempio, se un drone incontra una forte raffica di vento, Yang e i suoi colleghi vogliono assicurarsi che rimanga stabile e completi la missione.

Intendono inoltre applicare il loro metodo a problemi di ottimizzazione, in cui l’obiettivo è ridurre il tempo e la distanza necessari a un robot per completare un’attività mantenendo la stabilità. Hanno in programma di espandere la loro tecnologia per includere esseri umani e altre macchine nel mondo reale, dove un robot deve rimanere stabile mentre comunica con l’ambiente circostante.

Ross Tedrick, professore di ingegneria elettronica, meccanica e aerospaziale al MIT, vicepresidente per la ricerca sulla robotica al TRIS e membro dell’Institute for Computer Science and Artificial Intelligence, è uno degli autori senior di questo articolo. L’articolo dà credito anche al dottorando dell’UCLA Chuxing Shi e al professore assistente Zhou-Jui Hsieh, nonché al professore assistente Huan Zhang dell’Università dell’Illinois a Urbana-Champaign. Il loro lavoro è stato sostenuto in parte da Amazon, dalla National Science Foundation, dall’Office of Naval Research e dal programma AI2050 di Schmidt Sciences. Il documento dei ricercatori sarà presentato alla Conferenza internazionale sull’apprendimento automatico del 2024.

“Internet savvy. TV fan. Infuriatingly humble analyst. Unapologetic Twitter pioneer. Freelance coffee fanatic.”